大数据治理与服务 构建高效、可信的数据处理新范式

在数据已成为核心生产要素的今天,海量、多源、异构的数据洪流既带来了前所未有的机遇,也伴生着质量参差、标准不一、安全风险等诸多挑战。如何驾驭这庞大的数据资产,使其真正转化为洞察力与价值?这离不开两大关键支柱:大数据治理与数据处理服务。二者相辅相成,共同构成了现代企业数据能力建设的基石。

一、大数据治理:为数据价值释放奠定基石

大数据治理并非单一的技术方案,而是一套覆盖数据全生命周期的管理体系,旨在确保数据的可用性、一致性、完整性、安全性与合规性。其核心目标是为组织提供高质量、可信赖的数据基础。

核心框架与实践:

1. 战略与组织保障:确立数据作为战略资产的定位,建立跨部门的数据治理委员会,明确权责,制定与企业目标一致的数据战略。

2. 元数据与数据标准管理:统一数据的“身份证”(元数据)和“语言”(数据标准),确保不同系统、部门对数据的理解一致,是实现数据整合与共享的前提。

3. 数据质量管理:通过建立数据质量规则、实施全链路监控、定期评估与清洗,持续提升数据的准确性、完整性和及时性,让决策“心中有数”。

4. 数据安全与隐私保护:在数据采集、存储、使用、共享和销毁的全过程中,实施分级分类、访问控制、加密脱敏、审计追踪等措施,严守合规底线(如GDPR、个人信息保护法等),防范数据泄露与滥用风险。

5. 主数据管理:对客户、产品、组织等核心业务实体(主数据)进行统一、权威的定义和维护,确保关键数据“单一真相源”,支撑业务流程高效协同。

有效的治理如同为数据资产建立了清晰的“地图”和“交通规则”,是数据价值得以安全、合规、高效释放的根本保障。

二、数据处理服务:驱动数据价值转化的引擎

如果说治理构建了坚实的“路基”,那么数据处理服务则是其上高速运行的“车辆”。它是指利用一系列技术、工具和方法,对原始数据进行采集、清洗、整合、转换、分析和应用,最终形成可服务于业务决策、产品创新或流程优化的信息与知识。

关键服务层次与技术栈:

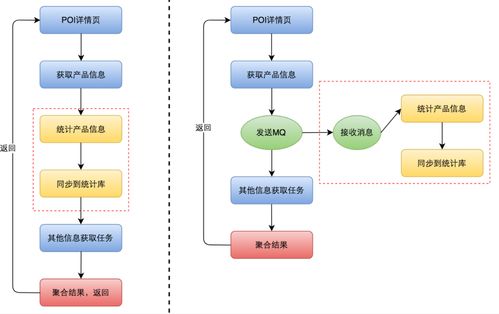

1. 数据集成与预处理服务:通过ETL/ELT、流式采集、数据同步等技术,将分散、异构的数据源汇聚到数据湖或数据仓库中,并进行初步的清洗与格式化,为后续分析做好准备。

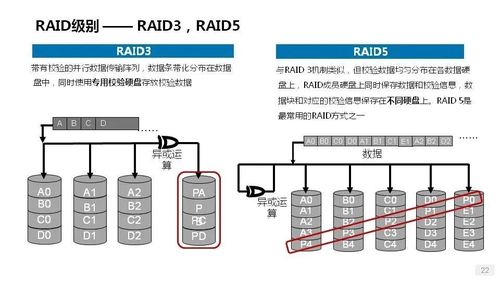

2. 数据存储与计算服务:基于Hadoop、Spark、Flink等分布式框架,或云上数据仓库(如Snowflake、BigQuery)、数据湖仓一体方案,提供海量数据的低成本存储与高性能并行计算能力。

3. 数据分析与挖掘服务:运用SQL查询、统计分析、机器学习、图计算等方法,从数据中发现模式、趋势与关联关系,生成预测模型与业务洞察。可视化工具(如Tableau、FineBI)则让洞察一目了然。

4. 数据服务化与API化:将处理后的数据或分析结果,封装成标准、易用的数据服务接口(API),供内部业务系统、应用或合作伙伴直接调用,实现数据能力的快速交付与复用,支撑敏捷业务创新。

5. 实时数据处理与流式服务:针对物联网、金融交易、在线推荐等对时效性要求极高的场景,提供实时数据摄入、流式计算与即时分析的能力,实现“秒级”甚至“毫秒级”的响应与决策。

三、治理与服务的融合:构建数据驱动型组织的闭环

大数据治理与数据处理服务绝非孤立的两个环节,而是紧密耦合、循环促进的有机整体。

- 治理赋能服务:高质量的治理为数据处理服务提供了干净、可信、标准化的“原材料”,大幅降低了后续数据清洗、整合与分析的复杂度和成本,提升了分析结果的可靠性与决策有效性。明确的权责与安全策略也保障了数据服务过程的安全可控。

- 服务反馈治理:数据处理服务在实践过程中,能够不断暴露出数据质量、标准、安全等方面的新问题与新需求,从而反向驱动治理策略、规则与流程的持续优化与迭代。例如,一个新的分析模型可能要求更细粒度的数据质量指标。

这种“治理定规则、服务出价值、反馈优治理”的闭环,共同推动组织从“拥有数据”迈向“善用数据”,最终构建起以数据为核心竞争力的智慧型组织。

###

在数字经济时代,大数据治理与数据处理服务是企业挖掘数据“石油”、炼制数据“燃料”不可或缺的两大核心能力。前者是确保数据资产健康、安全、合规的“治理体系”,后者是释放数据能量、驱动业务增长的“转化引擎”。只有将二者系统性地结合,建立持续演进的数据运营体系,才能让数据真正流动起来、用起来、活起来,在激烈的市场竞争中赢得先机。

如若转载,请注明出处:http://www.fuchenwork.com/product/60.html

更新时间:2026-04-16 16:39:06